Các Mô Hình AI Video Hot Nhất Mọi Lập Trình Viên Nên Biết

0

Các Mô Hình AI Video Phổ Biến và Ứng Dụng Đột Phá Trong Trí Tuệ Video

Mở Đầu

Bạn từng thắc mắc Netflix làm thế nào để đề xuất đúng trailer phim phù hợp, camera an ninh nhận diện các hoạt động bất thường hay các bình luận viên thể thao tạo ra những đoạn highlight tức thì như thế nào? Tất cả đều nhờ vào các mô hình AI Video - những công nghệ trí tuệ nhân tạo hiện đại xử lý hình ảnh chuyển động phức tạp một cách tự động và nhanh chóng.

Trong thời đại số, lượng dữ liệu video tăng vọt với khoảng 500 giờ video được tải lên YouTube mỗi phút. Để xử lý và khai thác hiệu quả nguồn dữ liệu đồ sộ này, các mô hình AI video được phát triển nhằm giúp máy móc có thể phân tích, hiểu và dự đoán các sự kiện diễn ra trong video. Bài viết này sẽ cung cấp cái nhìn tổng quan về những mô hình AI video nổi bật nhất hiện nay, cách chúng hoạt động và ứng dụng thực tế trong nhiều lĩnh vực từ giám sát an ninh, phân tích thể thao đến tạo nội dung số.

YOLO (You Only Look Once): Phát Hiện Đối Tượng Thời Gian Thực

Tổng Quan về YOLO

YOLO là mô hình phát hiện đối tượng hoạt động nhanh, xử lý toàn bộ hình ảnh chỉ qua một lần duy nhất trên mạng neural của nó. Khác với các phương pháp truyền thống như R-CNN hoặc Fast R-CNN, YOLO coi nhiệm vụ phát hiện như một bài toán hồi quy, trực tiếp dự đoán các hộp giới hạn (bounding boxes) và xác suất lớp đối tượng.

Các Đặc Điểm và Lợi Ích Chính

- Tốc độ thời gian thực: Phục vụ xử lý video với tần suất khung hình cao.

- Độ chính xác: Giảm thiểu sai sót và phát hiện nhiều đối tượng trong cùng một khung hình nhờ việc học tổng thể ngữ cảnh.

- Hiệu quả và nhẹ: Có thể chạy được trên các thiết bị biên (edge devices) với tài nguyên hạn chế.

- Dự đoán đa tỷ lệ: Phiên bản mới cải thiện khả năng phát hiện các vật thể nhỏ.

YOLO v8: Những Cải Tiến Mới Nhất

- Phát hiện không phụ thuộc anchor: Dự đoán trực tiếp vị trí trung tâm vật thể, tăng tốc quá trình học.

- Phương pháp augment dữ liệu Mosaic: Kết hợp 4 hình ảnh tạo sự đa dạng trong việc huấn luyện.

- Thành phần C2f: Thay thế C3 giúp cải thiện lưu thông gradient và tăng tốc huấn luyện.

- Đầu tách biệt: Độc lập giữa phân loại và hồi quy giúp tăng hiệu suất mô hình.

Các Ứng Dụng Thông Thường

- Giám sát: Phát hiện đám đông, cảnh báo xâm nhập và giám sát hành vi bất thường.

- Bán lẻ: Đếm số lượng sản phẩm, phân tích hành vi khách hàng và quản lý kho tự động.

- Thể thao: Theo dõi cầu thủ, bóng và thiết bị giúp phân tích hiệu suất trận đấu và nâng cao trải nghiệm truyền hình trực tiếp.

MoViNet: Mô Hình Nhận Diện Hành Động Hiệu Quả Cho Thiết Bị Biên

Giới Thiệu MoViNet

MoViNet (Mobile Video Networks) xử lý nhận diện hành động trong video trực tuyến một cách hiệu quả về mặt tính toán và bộ nhớ, vượt trội so với các kiến trúc CNN 2D truyền thống vốn nặng nề.

MoViNet áp dụng kỹ thuật Neural Architecture Search (NAS) để tạo nên cấu trúc CNN 3D tối ưu, đồng thời sử dụng stream buffering và tập hợp kết quả các mô hình để đạt độ chính xác và hiệu quả cao.

Điểm Nổi Bật

- Độ trễ thấp: Phù hợp với yêu cầu xử lý thời gian thực.

- Hiệu suất cao: Đạt chuẩn trên nhiều bộ dữ liệu thử nghiệm.

- Khả năng mở rộng: Có nhiều phiên bản để phù hợp với các giới hạn tài nguyên khác nhau.

Ứng Dụng Trên Thiết Bị Biên

MoViNet hoạt động xuất sắc trên điện thoại thông minh, thiết bị đeo nhờ khả năng xử lý tuần tự các khung hình với bộ nhớ không đổi. Ứng dụng trong:

- Phân tích hành động thể thao.

- Giám sát sức khoẻ cá nhân, vật lý trị liệu.

- Nhà thông minh với nhận diện cử chỉ và an ninh tự động.

SlowFast: Mô Hình Hai Luồng Cho Nhận Diện Hành Động

Kiến Trúc SlowFast

SlowFast là mạng neural hai luồng xử lý video ở hai tốc độ khác nhau. Luồng Slow xử lý ở tốc độ thấp để bắt các đặc trưng không gian, trong khi luồng Fast chạy ở tốc độ cao để bắt các động tác nhanh.

Ưu Điểm

- Kiến trúc hai luồng: Kết hợp tốt thông tin không gian và thời gian.

- Hiệu quả tính toán: Giảm kênh ở luồng nhanh để tiết kiệm tài nguyên.

- Hiệu suất hàng đầu: Thống trị trên nhiều bộ dữ liệu nhận diện hành động phổ biến.

Sức Mạnh trong Video Phức Tạp

SlowFast rất mạnh trong các nhiệm vụ nhận diện hành động phức tạp, giúp phân tích các hoạt động có tốc độ thay đổi khác nhau một cách chính xác và toàn diện.

Ứng Dụng

- Phân tích thể thao chuyên sâu.

- Giám sát an ninh bằng nhận diện hành vi nghi ngờ.

- Gắn nhãn và phân loại nội dung trong ngành giải trí.

TimeSformer: Mô Hình Transformer Cho Hiểu Biết Video và Đóng Gói Đặc Trưng

Giới Thiệu TimeSformer

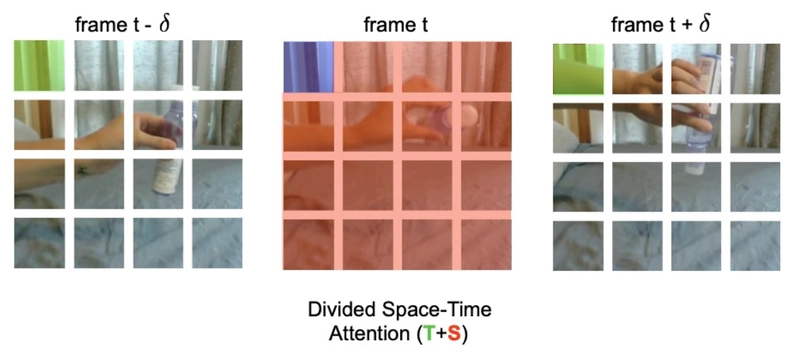

TimeSformer ứng dụng kiến trúc mô hình transformer vốn phổ biến trong xử lý ngôn ngữ tự nhiên cho tác vụ nhận diện video. Mô hình sử dụng cơ chế tự chú ý (self-attention) theo không gian và thời gian, giúp xử lý dữ liệu video nhanh hơn và hiệu quả hơn biểu đồ 3D CNN truyền thống.

Tính Năng Nổi Bật

- Khả năng mở rộng cao: Huấn luyện trên các đoạn video dài tới 102 giây.

- Chi phí tính toán thấp: Chỉ soi xét một số nhỏ các vùng ảnh (patches) để giảm thời gian.

- Cơ chế chú ý chia tách không gian và thời gian giúp tăng độ chính xác.

Ứng Dụng Trong Phân Loại và Nhận Diện Video

TimeSformer có thể phát hiện chính xác các hành động và phân loại thể loại video nhờ khả năng xử lý chuỗi video dài với độ chi tiết lớn.

Các Ví Dụ Ứng Dụng

- Nhận diện hành vi trong video thể thao, an ninh.

- Phân loại video theo thể loại (hài kịch, thể thao, tài liệu...).

- Lọc nội dung độc hại dành cho các nền tảng như YouTube, TikTok.

CLIP: Mô Hình Liên Kết Ngôn Ngữ và Hình Ảnh

Giới Thiệu CLIP

CLIP (Contrastive Language-Image Pre-training) do OpenAI phát triển, học mối liên hệ giữa hình ảnh và mô tả ngôn ngữ tự nhiên trên tập dữ liệu khổng lồ. Có thể mở rộng cho video bằng cách xử lý các khung hình riêng lẻ và liên kết chúng với văn bản.

Đặc Điểm và Ưu Điểm

- Liên kết chặt chẽ giữa video và ngôn ngữ, hỗ trợ tìm kiếm video bằng câu truy vấn tự nhiên.

- Tiết kiệm chi phí và hiệu quả nhờ khai thác dữ liệu không cần gắn nhãn.

- Phù hợp với nhiều tác vụ: phân loại, nhận diện hành động, OCR.

- Linh hoạt trong việc áp dụng cho nhiều nền tảng và hơn thế nữa.

Ứng Dụng Tìm Kiếm và Truy Xuất

Khi tích hợp với các hệ thống quản lý dữ liệu vector như Milvus hoặc Zilliz Cloud, CLIP cho phép tìm kiếm video qua mô tả ngôn ngữ cực kỳ tiện lợi và chính xác. Ví dụ, bạn có thể tìm các cảnh biển trong một bộ phim dựa trên câu lệnh “find all scenes with a beach”.

Ứng Dụng Thông Thường

- Tìm kiếm và truy xuất đa phương tiện.

- Duyệt và lọc nội dung tự động trên nền tảng mạng xã hội.

- Tạo chú thích tự động cho hình ảnh và video.

I3D (Inflated 3D ConvNet): Mạng 3D Convolution Cho Đặc Trưng Video

Khái Quát I3D

I3D là kiến trúc DeepMind nâng cấp từ mạng 2D CNN truyền thống thành 3D CNN bằng cách bơm phồng các bộ lọc 2D lên 3D, từ đó xử lý không gian và thời gian cùng lúc trong video.

Điểm Nổi Bật

- Bơm phồng bộ lọc 3D: Tận dụng trọng số đã học từ mạng 2D tăng hiệu quả huấn luyện.

- Huấn luyện trên bộ dữ liệu lớn Kinetics về nhận diện hành động con người.

- Kiến trúc hai luồng RGB và quang lưu (optical flow) giúp cải thiện độ chính xác.

Ứng Dụng Chủ Đạo

- Nhận diện các hành động con người trong giám sát, chăm sóc sức khỏe.

- Nhận dạng cử chỉ trong dịch thuật ngôn ngữ ký hiệu, AR/VR.

- Phát hiện bất thường trong video an ninh.

Kết Luận

Các mô hình AI video đang làm thay đổi sâu sắc cách chúng ta khám phá và tận dụng dữ liệu video. Từ việc phát hiện đối tượng thời gian thực bằng YOLO, nhận diện hành động hiệu quả với MoViNet, phân tích hành động phức tạp qua SlowFast, đến khai thác kiến trúc transformer với TimeSformer, nối kết ngôn ngữ - hình ảnh bằng CLIP và mô hình 3D CNN tiên tiến I3D, mỗi mô hình đều có những thế mạnh riêng biệt và ứng dụng rộng rãi.

Việc hiểu và áp dụng các mô hình video AI này sẽ mở ra nhiều cơ hội đột phá trong giám sát an ninh, phân tích thể thao, chăm sóc sức khỏe và sáng tạo nội dung số. Hãy thử khám phá các mô hình này để tận dụng tối đa sức mạnh của trí tuệ nhân tạo video trong dự án tiếp theo của bạn!

Tham Khảo

- Redmon, J. et al. (2016). YOLO: You Only Look Once. https://arxiv.org/abs/1506.02640

- Yang, Z. et al. (2021). MoViNet: Mobile Video Networks for Efficient Video Recognition. https://arxiv.org/abs/2103.11511

- Feichtenhofer, C. et al. (2019). SlowFast networks for video recognition. https://arxiv.org/abs/1812.03982

- Bertasius, G. et al. (2021). TimeSformer: Video Transformer for Video Understanding. https://arxiv.org/abs/2102.05095

- Radford, A. et al. (2021). CLIP: Learning Transferable Visual Models From Natural Language Supervision. https://openai.com/blog/clip

- Carreira, J. & Zisserman, A. (2017). Quo Vadis, Action Recognition? A New Model and the Kinetics Dataset. https://arxiv.org/abs/1705.07750

1

100%

Loading...